Apache Spark 1.4.1 发布,开源集群计算系统

发布于 2015-07-19 00:57:03 | 183 次阅读 | 评论: 0 | 来源: 网友投递

Apache Spark

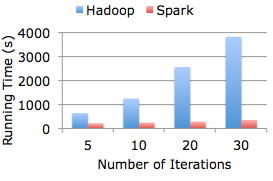

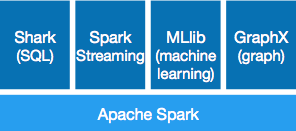

Spark是UC Berkeley AMP lab所开源的类Hadoop MapReduce的通用的并行,Spark,拥有Hadoop MapReduce所具有的优点;但不同于MapReduce的是Job中间输出结果可以保存在内存中,从而不再需要读写HDFS,因此Spark能更好地适用于数据挖掘与机器学习等需要迭代的map reduce的算法。

Apache Spark 1.4.1 发布,此版本是个维护版本,包括一些稳定性修复(DataFrame API, Spark Streaming, PySpark, Spark SQL 和 MLlib),基于 Spark 1.4 分支。强烈建议所有用户升级到最新版本,此版本贡献开发者有 85 人。

Spark 1.4.1 现已提供在下载页面。

更新内容

Data Sources and DataFrames

-

SPARK-8804: Order of UTF8String is not consistent with String if there is any non-ascii character in it

-

SPARK-8406: Race condition when writing Parquet files

-

SPARK-8329: DataSource options parser no longer accepts ‘_’

-

SPARK-8368: ClassNotFoundException in closure for map

-

SPARK-8470: MissingRequirementError for ScalaReflection on user classes

-

SPARK-8358: DataFrame explode with alias and * fails

MLLib

-

SPARK-8151: Pipeline components should correctly implement copy

-

SPARK-8468: Some metrics in RegressionEvaluator should have negative sign

-

SPARK-8736: GBTRegressionModel shouldn’t threshold predictions

-

SPARK-8563: IndexedRowMatrix.computeSVD() yields the U with wrong numCols

PySpark

-

SPARK-8202: Infinite loop during external sort

-

SPARK-8573: Trigger exceptions when invalid operators are used

-

SPARK-8766: Support non ASCII characters in columns

SparkR

-

SPARK-8506: Support for Spark packages when initializing SparkR

-

SPARK-8085: Support for user defined schemas when reading from data sources

更多内容请看发行说明。

Spark是UC Berkeley AMP lab所开源的类Hadoop MapReduce的通用的并行,Spark,拥有Hadoop MapReduce所具有的优点;但不同于MapReduce的是Job中间输出结果可以保存在内存中,从而不再需要读写HDFS,因此Spark能更好地适用于数据挖掘与机器学习等需要迭代的map reduce的算法。

Apache Spark 是一种与 Hadoop 相似的开源集群计算环境,但是两者之间还存在一些不同之处,这些有用的不同之处使 Spark 在某些工作负载方面表现得更加优越,换句话说,Spark 启用了内存分布数据集,除了能够提供交互式查询外,它还可以优化迭代工作负载。

Spark 是在 Scala 语言中实现的,它将 Scala 用作其应用程序框架。与 Hadoop 不同,Spark 和 Scala 能够紧密集成,其中的 Scala 可以像操作本地集合对象一样轻松地操作分布式数据集。

尽 管创建 Spark 是为了支持分布式数据集上的迭代作业,但是实际上它是对 Hadoop 的补充,可以在 Hadoo 文件系统中并行运行。通过名为 Mesos 的第三方集群框架可以支持此行为。Spark 由加州大学伯克利分校 AMP 实验室 (Algorithms, Machines, and People Lab) 开发,可用来构建大型的、低延迟的数据分析应用程序。

历史版本 :

Apache Spark 2.2.0 正式发布,提高可用性和稳定性

Spark 2.0 时代全面到来 —— 2.0.1 版本发布

Apache Spark 2.0.0 发布,APIs 更新

Apache Spark 1.6.2 发布,集群计算环境

Spark 2.0 预览:更简单,更快,更智能

Spark 2.7.6 发布,开源集群计算环境

Apache spark 1.6.1 发布,集群计算环境

Apache Spark 2.0 最快今年4月亮相

Apache Spark 1.6 正式发布,性能大幅度提升

Apache Spark 1.6 预览版:更简便的搜索

Apache Spark 1.5.2 发布,开源集群计算环境

Apache Spark 1.5.1 发布,开源集群计算环境